Python 文本数据增强

作者:追风剑情 发布于:2026-4-24 15:58 分类:AI

文本数据增强(Text Data Augmentation)指通过对原始文本进行有策略的变换(如同义词替换、随机删除、回译等),生成更多样化的训练样本,目的是:

- 扩充有限的训练数据集;

- 提高模型的泛化能力;

- 缓解过拟合。

一、安装依赖包

jieba是一个中文分词库

pip install jieba

示例

import random

import jieba

from langchain_ollama import ChatOllama

from langchain_core.messages import HumanMessage

# ========== 1. 初始化本地 Ollama DeepSeek 模型 ==========

llm = ChatOllama(base_url="http://localhost:11434", model="deepseek-r1:7b")

# ========== 2. 中文停用词表(包含标点符号) ==========

stopwords_cn = set([

'的', '了', '是', '我', '你', '他', '她', '它', '我们', '你们', '他们',

'和', '与', '或', '但', '也', '就', '都', '不', '在', '有', '这个', '那个',

'一个', '一些', '这种', '那些', '然后', '所以', '因为', '如果', '虽然',

# 添加常见标点

'。', ',', '、', '!', '?', ';', ':', '“', '”', '‘', '’', '(', ')', '【', '】', '《', '》'

])

# ========== 3. 中文同义词字典 ==========

synonyms_dict = {

"自然语言": ["自然语言处理", "自然语言技术", "语言处理"],

"人工智能": ["AI", "人工智慧"],

"领域": ["方向", "范畴", "分支"],

"子领域": ["分支", "子方向"],

"处理": ["加工", "分析"],

"技术": ["方法", "手段"],

"机器": ["计算机"],

"学习": ["训练", "学习过程"],

"深度": ["深层"],

"神经网络": ["神经网路", "类神经网络"],

}

def get_synonyms_cn(word):

"""返回一个中文词的同义词列表,如果没有则返回空列表"""

return synonyms_dict.get(word, [])

# ========== 4. 同义词替换函数 ==========

def synonym_replacement_cn(words_list, n):

new_words = words_list.copy()

# 候选词:不在停用词表中的词

candidates = [w for w in words_list if w not in stopwords_cn]

if not candidates:

return words_list

random.shuffle(candidates)

replaced = 0

for target in candidates:

syns = get_synonyms_cn(target)

if syns:

synonym = random.choice(syns)

# 替换所有出现的位置

new_words = [synonym if w == target else w for w in new_words]

replaced += 1

if replaced >= n:

break

return new_words

# ========== 5. 随机删除函数(增加空列表保护) ==========

def random_deletion_cn(words_list, p):

if len(words_list) <= 1:

return words_list.copy()

new_words = [w for w in words_list if random.uniform(0, 1) > p]

if not new_words:

# 避免返回空列表,至少保留第一个词

return words_list.copy()

return new_words

# ========== 6. 原始中文测试语句 ==========

sentence = "自然语言处理是人工智能的一个子领域。"

# 手动添加词汇到 jieba 词典

jieba.add_word("子领域")

words = jieba.lcut(sentence)

print("原始分词结果:", words)

# ========== 7. 规则增强 ==========

augmented_words = synonym_replacement_cn(words, n=2)

augmented_sentence = ''.join(augmented_words)

print("同义词替换后:", augmented_sentence)

deleted_words = random_deletion_cn(words, p=0.2)

deleted_sentence = ''.join(deleted_words)

print("随机删除后:", deleted_sentence)

# ========== 8. 使用本地 LLM 生成增强文本 ==========

prompt = f"请对以下中文文本进行改写或扩充,生成一个意思相近但表达不同的增强版本,只输出增强后的句子,不要包含任何额外解释或思考过程:\n{ sentence }"

try:

response = llm.invoke([HumanMessage(content=prompt)])

print("LLM 增强结果:", response.content)

except Exception as e:

print(f"LLM 调用失败: {e}")

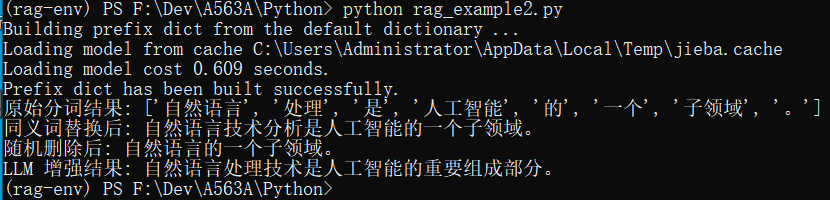

运行测试

标签: AI

日历

最新文章

随机文章

热门文章

分类

存档

- 2026年6月(1)

- 2026年5月(29)

- 2026年4月(7)

- 2026年3月(15)

- 2026年2月(3)

- 2026年1月(6)

- 2025年12月(1)

- 2025年11月(1)

- 2025年9月(3)

- 2025年7月(4)

- 2025年6月(5)

- 2025年5月(1)

- 2025年4月(5)

- 2025年3月(4)

- 2025年2月(3)

- 2025年1月(1)

- 2024年12月(5)

- 2024年11月(5)

- 2024年10月(5)

- 2024年9月(3)

- 2024年8月(3)

- 2024年7月(11)

- 2024年6月(3)

- 2024年5月(9)

- 2024年4月(10)

- 2024年3月(11)

- 2024年2月(24)

- 2024年1月(12)

- 2023年12月(3)

- 2023年11月(9)

- 2023年10月(7)

- 2023年9月(2)

- 2023年8月(7)

- 2023年7月(9)

- 2023年6月(6)

- 2023年5月(7)

- 2023年4月(11)

- 2023年3月(6)

- 2023年2月(11)

- 2023年1月(8)

- 2022年12月(2)

- 2022年11月(4)

- 2022年10月(10)

- 2022年9月(2)

- 2022年8月(13)

- 2022年7月(7)

- 2022年6月(11)

- 2022年5月(18)

- 2022年4月(29)

- 2022年3月(5)

- 2022年2月(6)

- 2022年1月(8)

- 2021年12月(5)

- 2021年11月(3)

- 2021年10月(4)

- 2021年9月(9)

- 2021年8月(14)

- 2021年7月(8)

- 2021年6月(5)

- 2021年5月(2)

- 2021年4月(3)

- 2021年3月(7)

- 2021年2月(2)

- 2021年1月(8)

- 2020年12月(7)

- 2020年11月(2)

- 2020年10月(6)

- 2020年9月(9)

- 2020年8月(10)

- 2020年7月(9)

- 2020年6月(18)

- 2020年5月(4)

- 2020年4月(25)

- 2020年3月(38)

- 2020年1月(21)

- 2019年12月(13)

- 2019年11月(29)

- 2019年10月(44)

- 2019年9月(17)

- 2019年8月(18)

- 2019年7月(25)

- 2019年6月(25)

- 2019年5月(17)

- 2019年4月(10)

- 2019年3月(36)

- 2019年2月(35)

- 2019年1月(28)

- 2018年12月(30)

- 2018年11月(22)

- 2018年10月(4)

- 2018年9月(7)

- 2018年8月(13)

- 2018年7月(13)

- 2018年6月(6)

- 2018年5月(5)

- 2018年4月(13)

- 2018年3月(5)

- 2018年2月(3)

- 2018年1月(8)

- 2017年12月(35)

- 2017年11月(17)

- 2017年10月(16)

- 2017年9月(17)

- 2017年8月(20)

- 2017年7月(34)

- 2017年6月(17)

- 2017年5月(15)

- 2017年4月(32)

- 2017年3月(8)

- 2017年2月(2)

- 2017年1月(5)

- 2016年12月(14)

- 2016年11月(26)

- 2016年10月(12)

- 2016年9月(25)

- 2016年8月(32)

- 2016年7月(14)

- 2016年6月(21)

- 2016年5月(17)

- 2016年4月(13)

- 2016年3月(8)

- 2016年2月(8)

- 2016年1月(18)

- 2015年12月(13)

- 2015年11月(15)

- 2015年10月(12)

- 2015年9月(18)

- 2015年8月(21)

- 2015年7月(35)

- 2015年6月(13)

- 2015年5月(9)

- 2015年4月(4)

- 2015年3月(5)

- 2015年2月(4)

- 2015年1月(13)

- 2014年12月(7)

- 2014年11月(5)

- 2014年10月(4)

- 2014年9月(8)

- 2014年8月(16)

- 2014年7月(26)

- 2014年6月(22)

- 2014年5月(28)

- 2014年4月(15)

友情链接

- Unity官网

- Unity圣典

- Unity在线手册

- Unity中文手册(圣典)

- Unity官方中文论坛

- Unity游戏蛮牛用户文档

- Unity下载存档

- Unity引擎源码下载

- Unity服务

- Unity Ads

- wiki.unity3d

- Visual Studio Code官网

- SenseAR开发文档

- MSDN

- C# 参考

- C# 编程指南

- .NET Framework类库

- .NET 文档

- .NET 开发

- WPF官方文档

- uLua

- xLua

- SharpZipLib

- Protobuf-net

- Protobuf.js

- OpenSSL

- OPEN CASCADE

- JSON

- MessagePack

- C在线工具

- 游戏蛮牛

- GreenVPN

- 聚合数据

- 热云

- 融云

- 腾讯云

- 腾讯开放平台

- 腾讯游戏服务

- 腾讯游戏开发者平台

- 腾讯课堂

- 微信开放平台

- 腾讯实时音视频

- 腾讯即时通信IM

- 微信公众平台技术文档

- 白鹭引擎官网

- 白鹭引擎开放平台

- 白鹭引擎开发文档

- FairyGUI编辑器

- PureMVC-TypeScript

- 讯飞开放平台

- 亲加通讯云

- Cygwin

- Mono开发者联盟

- Scut游戏服务器引擎

- KBEngine游戏服务器引擎

- Photon游戏服务器引擎

- 码云

- SharpSvn

- 腾讯bugly

- 4399原创平台

- 开源中国

- Firebase

- Firebase-Admob-Unity

- google-services-unity

- Firebase SDK for Unity

- Google-Firebase-SDK

- AppsFlyer SDK

- android-repository

- CQASO

- Facebook开发者平台

- gradle下载

- GradleBuildTool下载

- Android Developers

- Google中国开发者

- AndroidDevTools

- Android社区

- Android开发工具

- Google Play Games Services

- Google商店

- Google APIs for Android

- 金钱豹VPN

- TouchSense SDK

- MakeHuman

- Online RSA Key Converter

- Windows UWP应用

- Visual Studio For Unity

- Open CASCADE Technology

- 慕课网

- 阿里云服务器ECS

- 在线免费文字转语音系统

- AI Studio

- 网云穿

- 百度网盘开放平台

- 迅捷画图

- 菜鸟工具

- [CSDN] 程序员研修院

- 华为人脸识别

- 百度AR导航导览SDK

- 海康威视官网

- 海康开放平台

- 海康SDK下载

- git download

- Open CASCADE

- CascadeStudio

- OpenClaw中文社区

- three.js manual

- SVG官方文档

交流QQ群

-

Flash游戏设计: 86184192

Unity游戏设计: 171855449

游戏设计订阅号